생각의 외주화 — AI가 당신의 뇌를 대체하고 있다

Advait Sarkar의 TED 강연을 보고 정리한 생각. AI에게 사고를 외주하면 우리는 "자기 생각의 중간관리자"가 된다. 효율은 올라가는데 머리는 비어간다.

유튜브 알고리즘이 또 일했다

월요일 밤이었다. 이불 속에서 유튜브를 켰다. 알고리즘이 던져준 영상 하나가 눈에 걸렸다. 제목이 짧았다. “생각의 외주화.”

비즈까페(BZCF) 채널이었다. 원본은 Advait Sarkar라는 Microsoft Research 연구원의 TED 강연. 11분짜리 영상인데, 3분 만에 자세를 고쳐 앉았다.

이 사람이 정확히 내가 요즘 느끼던 불편함을 언어화해 줬다.

우리는 “자기 생각의 중간관리자”가 됐다

Sarkar가 던진 핵심 문장이 있다.

“우리는 자신의 생각을 위한 중간관리자가 되었다.”

이메일이 오면 AI에게 요약을 시킨다. 보고서를 쓸 때 AI에게 초안을 맡긴다. 데이터 분석도 AI가 한다. 나는 뭘 하냐면 — AI가 만든 결과물을 검토한다. 승인하거나 수정 지시를 내린다. 마치 중간관리자처럼.

문제는 이게 꽤 편하다는 거다. 편해서 멈추지 못한다는 거다.

AI 사용의 다섯 가지 부작용

Sarkar는 연구 결과를 기반으로 AI가 인간의 인지 능력에 미치는 부작용을 다섯 가지로 정리했다.

1. 창의성이 줄어든다

개인 단위로 보면 AI가 창의성을 높여주는 것 같다. 아이디어가 빨리 나오니까. 근데 집단 차원에서 보면 정반대다. 모두가 같은 AI를 쓰니까 같은 아이디어가 나온다. “따분한 집단지성”이라고 Sarkar는 표현했다. 다들 똑같은 5가지 아이디어를 들고 회의실에 들어오는 풍경.

2. 비판적 사고가 약해진다

AI를 신뢰할수록 스스로 판단하려는 노력이 줄어든다. 당연하다. 이미 그럴듯한 답이 나와 있는데, 왜 굳이 의심하겠는가. 근데 그 “의심하는 근육”이 빠지면, AI 없이는 판단 자체를 못 하게 된다.

3. 기억력이 나빠진다

AI가 쓴 글은 내가 덜 기억한다. AI가 요약한 문서도 직접 읽은 것보다 훨씬 기억에 안 남는다. 뇌가 “이건 내 일이 아니다”라고 판단하는 것 같다. 외주 준 일은 기억할 필요가 없으니까.

4. 메타인지가 무너진다

메타인지란 “내가 뭘 알고 뭘 모르는지 아는 능력”이다. AI를 쓸수록 이게 흐려진다. 과제를 어떻게 쪼갤지, AI가 이 문제에 적합한지, 결과물이 맞는지 — 이런 판단을 할 줄 모르게 된다.

5. 지적 관광객이 된다

Sarkar의 표현이 좋았다. “지적 관광객.” 아이디어를 방문만 하고, 이해하지는 않는다. 깊이 파고들지 않는다. 관광객이 그 도시에 살지 않듯이, 우리는 그 생각에 살지 않게 된다.

운동을 없앤 뒤 숨이 차는 이유

강연에서 가장 인상 깊었던 비유가 있다.

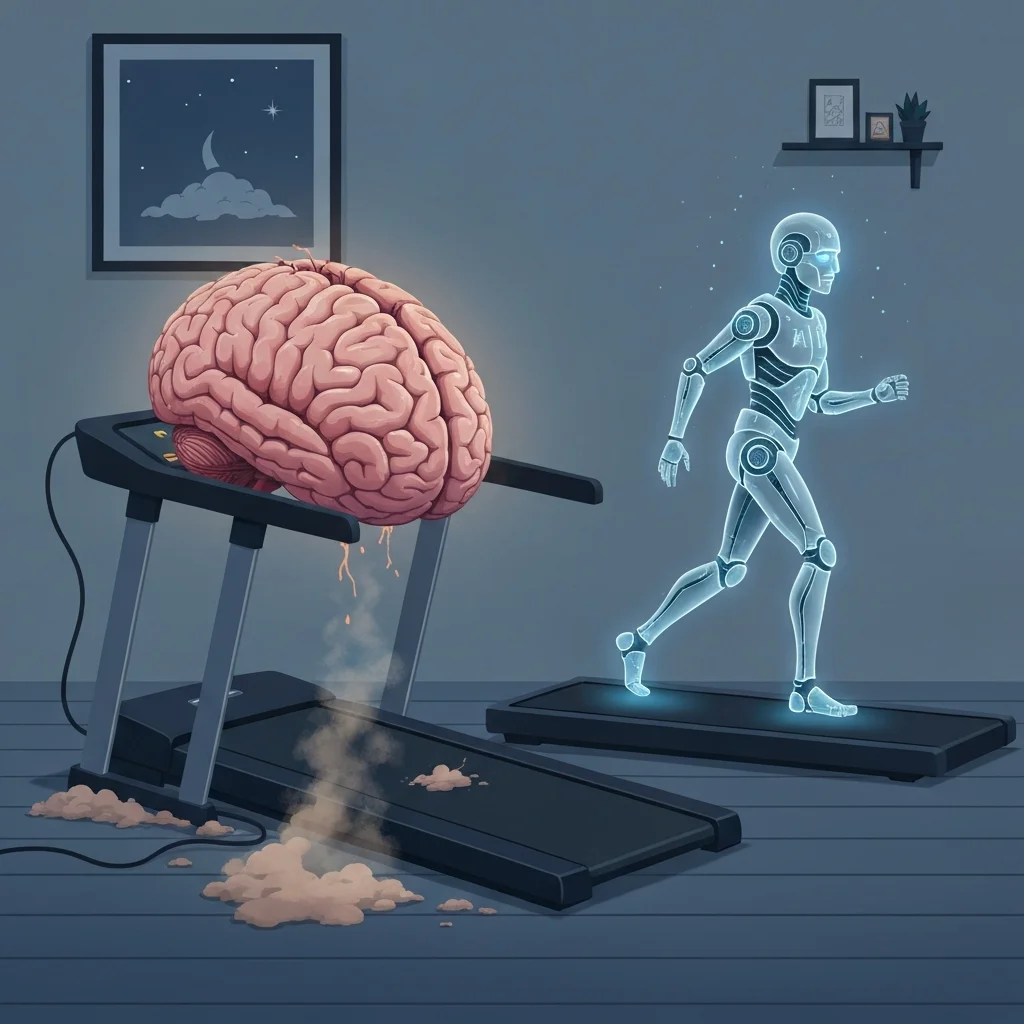

“운동을 없애는 약을 발명한 후, 왜 계속 숨이 차는지 궁금해하는 것과 같다.”

AI는 “생각한다는 문제”를 해결했다. 근데 생각은 원래 문제가 아니었다. 생각은 운동이었다. 뇌를 건강하게 유지하는 과정 그 자체였다.

나는 이 비유를 듣고 한참을 멍하니 있었다. 내가 매일 하는 일이 정확히 이거였으니까. Claude Code에게 코드를 시키고, ChatGPT에게 이메일을 맡기고, AI에게 분석을 외주하면서 — “효율적이다”고 자부하고 있었다.

효율적이긴 했다. 근데 내 머리가 예전 같지 않다는 건 느끼고 있었다.

해결책: “생각하게 만드는 도구”

Sarkar가 제안하는 해결책이 현실적이었다. “AI를 쓰지 마라”가 아니다. AI의 설계 방식을 바꾸자는 거다.

그가 Microsoft Research에서 만든 프로토타입은 세 가지 원칙을 따른다.

원칙 1: 직접 만지게 하라

사용자가 여전히 재료를 직접 다루게 해야 한다. AI가 전부 처리하는 게 아니라, 전략적 지점에서 인간이 개입하는 구조. 예를 들어 보고서를 분석할 때, AI가 전체를 요약하는 대신 특정 “렌즈”로 재구성해서 사용자가 직접 읽게 만든다.

원칙 2: 생산적 저항을 제공하라

자동 완성이 아니라 “도발(provocations)”을 제공한다. AI가 모순을 지적하고, 반론을 제시하고, 놓친 기회를 알려준다. 답을 주는 게 아니라 질문을 던진다.

이 부분이 핵심이라고 생각한다. 좋은 멘토는 답을 주지 않는다. 좋은 질문을 던진다. AI도 그래야 한다.

원칙 3: 메타인지를 도와라

“지금 내가 뭘 하고 있는지” 계속 인식하게 만든다. 작업 목표를 스스로 설정하고, 과제를 분해하고, 결과를 평가하는 구조. AI가 시키는 대로 따라가는 게 아니라, 내가 AI를 도구로 쓰고 있다는 자각을 유지하게 하는 것.

나는 어떻게 쓰고 있었나

이 강연을 보고 솔직하게 점검해 봤다.

나는 Claude Code를 매일 쓴다. 코드를 짜고, 블로그를 쓰고, 분석하고, 자동화한다. 이 블로그 시스템 자체가 텔레그램 봇 + Claude Code + Gemini 이미지 생성으로 돌아가는 파이프라인이다. 효율은 미쳤다.

근데 Sarkar의 기준으로 보면, 나는 “도발”을 받고 있었을까? AI의 결과물에 비판적으로 접근하고 있었을까? 아니면 그냥 승인 버튼을 누르는 중간관리자였을까?

솔직히 반반이다. 코드는 내가 검토한다. 직접 돌려보고, 로직을 따져본다. 이 부분은 괜찮다. 근데 글쓰기는? AI가 초안을 쓰면 “음, 괜찮네” 하고 넘기는 경우가 많았다.

그게 위험한 거였다. 글쓰기는 생각하는 과정 그 자체다. 그걸 외주 주면 생각을 외주 주는 거다.

그래서 뭘 바꿀 건가

이 영상을 보고 나서 세 가지를 정했다.

1. AI 초안을 그대로 쓰지 않는다. AI가 만든 건 재료일 뿐이다. 내 문체로, 내 관점으로 다시 쓴다. 시간이 더 걸리더라도.

2. AI에게 “도발”을 요청한다. “이 논리에 반론을 만들어 봐”, “내가 놓치고 있는 관점이 뭐야” — 이런 프롬프트를 의식적으로 쓴다.

3. 일주일에 한 번은 AI 없이 글을 쓴다. 순수하게 내 머리에서 나온 생각만으로. 불편하겠지만, 그 불편함이 운동이다.

마무리

Sarkar의 마지막 질문이 계속 맴돈다.

“당신은 무엇을 원하는가? 당신 대신 생각하는 도구인가, 당신을 생각하게 만드는 도구인가?”

나는 후자를 원한다. 근데 현실에서는 전자를 쓰고 있었다. 그 간극을 인식하는 것부터가 시작이라고 생각한다.

11분짜리 영상 하나가 이렇게 길게 생각을 끌어낸 건 오랜만이다. 그리고 아이러니하게도 — 이 영상의 제목처럼, 이 글을 쓰는 행위 자체가 “생각을 외주하지 않는 연습”이었다.